Comprenda los principales protocolos de redes de computadoras, los modelos OSI y TCP/IP, y el papel de protocolos como Ethernet, Wi-Fi, IP, TCP, UDP, HTTP, DNS y BGP en la comunicacion digital.

¡Descúbrelo!

Los Protocolos de Red son conjuntos de reglas y estándares que posibilitan la comunicación entre dispositivos. Definen cómo los datos serán formateados, transmitidos, recibidos y procesados.

En este artículo, exploraremos los conceptos fundamentales de los protocolos de red, destacando su importancia en la estandarización de los sistemas de comunicación y en la garantía de la interoperabilidad entre diferentes sistemas.

¡Descúbralo!

[elementor-template id=”24446″]

¿Qué son los Protocolos de Red?

Un Protocolo de Red define el formato y el orden de los mensajes intercambiados entre dos o más “entidades” que se comunican, así como las acciones tomadas durante la transmisión y/o la recepción de un mensaje u otro “evento”.

Estos protocolos son fundamentales para garantizar la interoperabilidad entre dispositivos, permitiendo que diferentes sistemas de hardware y software puedan comunicarse de manera eficiente y organizada.

A través de una serie de reglas estandarizadas, los Protocolos de Red posibilitan el intercambio de datos en redes de área local (LAN) y redes de larga distancia (WAN), como Internet.

Modelos de Arquitectura de Red

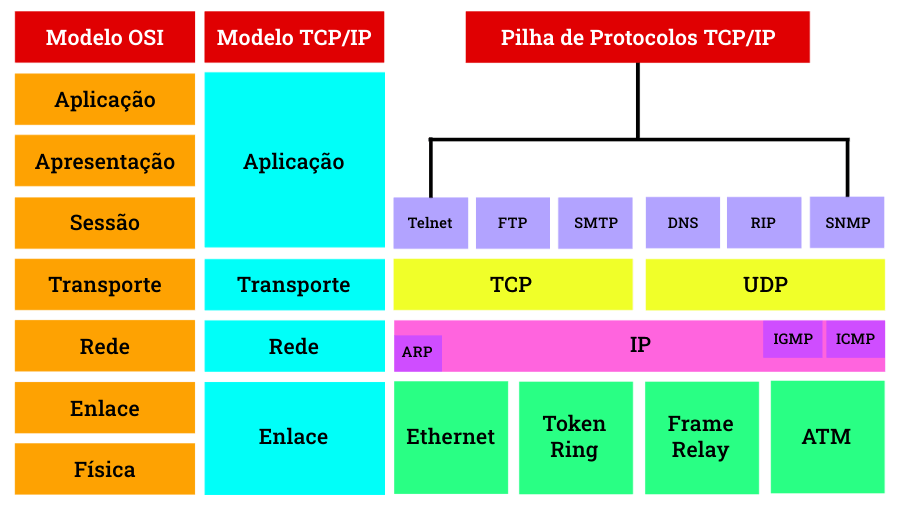

Para organizar de forma estructurada el funcionamiento de las redes de comunicación, los protocolos y los componentes de hardware y software que los implementan se distribuyen en capas.

Cada protocolo está asociado a una capa específica en la arquitectura de red, y cada capa ofrece servicios bien definidos a la capa superior. Este modelo jerárquico organiza la comunicación de manera estructurada, donde cada capa ejecuta funciones específicas y utiliza los servicios de la capa inferior para realizar sus operaciones.

Para proporcionar sus servicios, cada capa realiza operaciones internas, que pueden incluir tareas como formateo de datos, control de flujo y enrutamiento de paquetes, al mismo tiempo que depende de los servicios ofrecidos por la capa directamente inferior, que puede incluir el envío físico de bits, por ejemplo. La capa superior, a su vez, utiliza los servicios de esa capa para agregar funciones adicionales.

Modelo OSI

El modelo OSI (Open Systems Interconnection), propuesto por la International Organization for Standardization (ISO) a finales de la década de 1970, es uno de los principales modelos de referencia utilizados para describir la comunicación en redes de computadoras.

Fue diseñado para organizar la comunicación de red en siete capas distintas, cada una con responsabilidades y funciones bien definidas:

- Capa Física;

- Capa de Enlace;

- Capa de Red;

- Capa de Transporte;

- Capa de Sesión;

- Capa de Presentación;

- Capa de Aplicación;

Creado antes del surgimiento de Internet, el modelo OSI proporciona una base teórica sólida para la construcción y comprensión de redes, facilitando la interoperabilidad entre sistemas de diferentes fabricantes y tecnologías.

Modelo TCP/IP

El Modelo TCP/IP es la estructura fundamental que sustenta el funcionamiento de Internet y de las redes de computadoras a escala global.

Desarrollado inicialmente en las décadas de 1970 y 1980, fue diseñado para permitir la comunicación entre redes heterogéneas y garantizar la interoperabilidad entre diferentes sistemas.

Este conjunto de protocolos permite que los datos se transmitan de manera eficiente y confiable, independientemente de la infraestructura o de las tecnologías utilizadas en cada segmento de la red.

Modelo OSI y Modelo TCP/IP.

La principal diferencia entre los modelos OSI y TCP/IP está en la forma en que tratan determinadas funcionalidades.

En el modelo OSI, servicios como la interpretación de datos, la sincronización y el control de sesiones se implementan en capas específicas: presentación y sesión.

En el modelo TCP/IP, esas mismas funcionalidades no son gestionadas por capas dedicadas. En su lugar, son responsabilidad del desarrollador de la aplicación, quien debe decidir si funcionalidades como compresión, cifrado y control de sesión son necesarias y cómo implementarlas directamente en las aplicaciones o protocolos.

Clasificación de los Protocolos de Red por Capa

Las implementaciones de estas capas varían y pueden ser en software, hardware o una combinación de ambos. Cuando los protocolos de todas las capas trabajan en conjunto, forman lo que llamamos una pila de protocolos.

Capa Física y de Enlace

La primera capa, conocida como capa de enlace, es responsable de gestionar la transmisión de datos entre dispositivos directamente conectados por un medio físico, ya sea cableado o inalámbrico. En algunos materiales, esta capa se divide en dos: capa de enlace de datos y capa física.

La capa de enlace combina la transmisión física de los bits con el control lógico que organiza esos bits en tramas, preparándolos para ser interpretados correctamente por los dispositivos de destino. Es responsable de diversas funciones críticas que garantizan una comunicación eficiente dentro de una red local.

Una de las principales responsabilidades de la capa de enlace es el direccionamiento físico, utilizando las direcciones MAC (Media Access Control) para identificar de manera única cada dispositivo conectado a la red.

Otro aspecto esencial es el framing o encapsulamiento en tramas, que encapsula los datos en tramas. Estas tramas contienen no solo los datos, sino también información de control, como direcciones de origen y destino y verificaciones de integridad, permitiendo que el receptor interprete adecuadamente los datos.

La capa de enlace también se encarga de la detección y corrección de errores, utilizando técnicas como checksums y códigos de redundancia cíclica (CRC) para garantizar que los datos no fueron corrompidos durante la transmisión. Si se detectan errores, la trama puede retransmitirse o descartarse.

El control de flujo es otra función esencial, que ajusta la cantidad de datos transmitidos para que el receptor pueda procesarlos correctamente, previniendo sobrecargas que podrían llevar a la pérdida de datos.

La capa de enlace también gestiona el control de acceso al medio, definiendo cuándo cada dispositivo puede transmitir datos, especialmente en redes donde el medio es compartido. Esto evita colisiones de datos, algo crucial en redes donde varios dispositivos comparten el mismo canal de comunicación, como en redes inalámbricas.

Por último, la capa de enlace puede realizar la segmentación y reordenamiento de los datos, dividiéndolos en tramas más pequeñas cuando sea necesario y reagrupándolos en el destino para que la transmisión sea completa y en la secuencia correcta.

Ethernet (IEEE 802.3)

Ethernet es un protocolo de enlace de datos estandarizado por el IEEE bajo el nombre IEEE 802.3. Ethernet define las reglas para la comunicación entre dispositivos en una red de área local (LAN), especificando cómo los datos deben organizarse, transmitirse y recibirse dentro de un medio físico compartido.

El protocolo Ethernet establece cómo los dispositivos se identifican entre sí, cómo los datos se encapsulan en tramas y cómo se verifica la integridad de la transmisión, además de tratar el acceso al medio y la detección de errores durante la transmisión.

La unidad básica de transmisión es la trama Ethernet, que encapsula los datos y la información de control. Está compuesta por diversos campos que garantizan la comunicación eficiente y correcta entre dispositivos.

Ethernet pasó por diversas evoluciones a lo largo de los años con el objetivo de aumentar la velocidad de transmisión y mejorar su eficiencia. Las primeras versiones operaban a 10 Mbps, pero con el tiempo surgieron variantes como Fast Ethernet (100 Mbps), Gigabit Ethernet (1 Gbps) y, más recientemente, versiones de 10 Gbps, 40 Gbps e incluso 100 Gbps.

Estas actualizaciones del estándar IEEE 802.3 permitieron que Ethernet se adaptara a las crecientes demandas de transmisión de datos, tanto en redes corporativas como en centros de datos. Además, Ethernet puede implementarse con diferentes medios físicos, como cables de cobre (par trenzado) y fibras ópticas, dependiendo de la velocidad y la distancia de transmisión requeridas.

Wi-Fi (IEEE 802.11)

El Wi-Fi, formalmente estandarizado como IEEE 802.11, es un conjunto de protocolos que define las especificaciones para la comunicación inalámbrica en redes locales (WLAN).

Desarrollado por el Institute of Electrical and Electronics Engineers (IEEE), el Wi-Fi se convirtió en el estándar dominante para conectar dispositivos sin necesidad de cables, siendo ampliamente utilizado en hogares, empresas y espacios públicos.

Permite la comunicación entre dispositivos como smartphones, laptops, tablets y routers, utilizando ondas de radio para transmitir datos.

Al igual que Ethernet, el Wi-Fi opera en la capa de enlace del modelo OSI, pero también abarca la capa física. En la capa de enlace, el protocolo Wi-Fi se encarga de la organización de los datos en tramas, del control de acceso al medio y del direccionamiento físico, mientras que en la capa física especifica cómo se utilizan las ondas de radio para transmitir y recibir datos.

El protocolo define cómo los dispositivos inalámbricos se comunican a través de frecuencias de radio, utilizando tecnologías como modulación, codificación de señal y control de potencia para asegurar una comunicación eficiente. Las bandas de frecuencia más comunes utilizadas por Wi-Fi son 2,4 GHz y 5 GHz, que soportan diferentes velocidades de transmisión y niveles de interferencia.

PPP (Point-to-Point Protocol)

El PPP (Point-to-Point Protocol) es un protocolo de comunicación utilizado para establecer una conexión directa entre dos puntos, normalmente entre dos dispositivos de red, como una computadora y un servidor de Internet, a través de líneas seriales, telefónicas o conexiones de datos dedicadas.

El protocolo PPP está estandarizado por la IETF (Internet Engineering Task Force) bajo la RFC 1661 y fue diseñado para proporcionar encapsulamiento de datagramas en una línea punto a punto, además de ofrecer mecanismos de autenticación, compresión y detección de errores, lo que lo hace adecuado para entornos de red donde la confiabilidad y el control de la conexión son esenciales.

ARP (Address Resolution Protocol)

El ARP (Address Resolution Protocol) es un protocolo que ayuda en la comunicación entre dispositivos de una red local. Su función principal es realizar la traducción de direcciones IP (direcciones lógicas) a direcciones MAC (direcciones físicas) en redes basadas en Ethernet. El ARP es crucial en redes IPv4, donde los dispositivos necesitan enviar datos entre sí utilizando tanto direcciones lógicas como físicas.

Cuando un dispositivo desea enviar un paquete a otro dentro de la misma red, necesita conocer la dirección MAC del dispositivo de destino. Sin embargo, normalmente los dispositivos conocen solo las direcciones IP de destino, ya que es la dirección IP la que identifica lógicamente a los dispositivos en la capa de red. Es en este punto donde entra en acción ARP: mapea la dirección IP conocida a la dirección MAC necesaria para la entrega de los datos en la capa de enlace.

El proceso de resolución de direcciones en ARP funciona de la siguiente manera: cuando un dispositivo quiere comunicarse con otro, verifica si la dirección IP de destino ya está asociada a una dirección MAC en su tabla ARP (una caché local que almacena estas correspondencias). Si la correspondencia ya está presente, el dispositivo envía los datos directamente a la dirección MAC correspondiente. Sin embargo, si no existe un mapeo, el dispositivo emite un ARP Request, que es un broadcast enviado a toda la red local preguntando “¿Quién tiene esta IP?” (en el formato: “¿Qué dirección MAC está asociada a la IP X?”). Todos los dispositivos de la red reciben el ARP Request, pero solo el dispositivo con la dirección IP correspondiente responde con un ARP Reply, proporcionando su dirección MAC.

Una vez obtenida la dirección MAC, el dispositivo de origen puede enviar el paquete directamente a la dirección física del dispositivo de destino utilizando el protocolo Ethernet. El mapeo IP-MAC obtenido se almacena temporalmente en la tabla ARP para reutilizarse, evitando la necesidad de resolver la dirección nuevamente en transmisiones futuras.

Capa de Red

La capa de red es responsable de gestionar el enrutamiento y la entrega de paquetes de datos entre diferentes redes, garantizando que la información pueda transmitirse desde un dispositivo de origen a un dispositivo de destino, incluso cuando se encuentren en redes distintas. Esta capa desempeña un papel crítico en la organización de la comunicación en redes complejas, especialmente en redes de larga distancia (WAN) y en Internet, donde los paquetes pueden atravesar varias redes intermedias hasta llegar a su destino.

Uno de los principales objetivos de la capa de red es encontrar la mejor ruta para la transmisión de los paquetes, lo que implica la comunicación entre dispositivos de diferentes redes y el movimiento de datos a través de routers, que son los responsables de gestionar el flujo de tráfico entre las redes.

La capa de red desempeña un papel fundamental en la comunicación entre diferentes redes. Permite que dispositivos en redes físicas o lógicas distintas se comuniquen sin necesidad de estar directamente conectados. Cuando un paquete necesita enviarse a un dispositivo en otra red, la capa de red decide cómo los paquetes serán encaminados a través de varias redes intermedias hasta alcanzar el destino final.

IP (Internet Protocol)

El IP (Internet Protocol) es el principal protocolo de la capa de red del modelo OSI y del modelo TCP/IP, responsable del direccionamiento y enrutamiento de paquetes de datos entre dispositivos conectados a una red. Es la base fundamental para el funcionamiento de Internet y de otras redes de comunicación, permitiendo que los paquetes de datos se entreguen del remitente al destinatario, independientemente de las redes intermedias involucradas.

El IP utiliza direcciones lógicas, conocidas como direcciones IP, para identificar de forma única cada dispositivo en una red. Estas direcciones permiten que los datos se entreguen al destino correcto, incluso cuando necesitan pasar por varias redes intermedias. El protocolo IP está diseñado para funcionar en redes de larga distancia, donde los datos pueden pasar por distintos routers hasta alcanzar el destino final. La dirección IP se divide en dos tipos principales: IPv4, que utiliza un espacio de direccionamiento de 32 bits, e IPv6, que utiliza 128 bits, permitiendo una cantidad mucho mayor de direcciones, esencial para responder a la creciente demanda de dispositivos conectados.

Al encapsular los datos en paquetes, el IP organiza y dirige la información de manera eficiente. Cada paquete IP contiene un encabezado con información crítica para el enrutamiento, como la dirección IP de origen y la de destino, además de un campo llamado TTL (Time to Live), que limita la cantidad de saltos que el paquete puede dar antes de ser descartado, evitando que circule indefinidamente en casos de problemas de enrutamiento. El encabezado IP también incluye información de control, como el tamaño del paquete y un checksum para verificar la integridad del encabezado.

Una característica importante del IP es la fragmentación, que ocurre cuando los paquetes de datos son mayores que el límite permitido por la red. En esos casos, el IP fragmenta el paquete en partes más pequeñas que pueden transmitirse de manera eficiente y reagruparse en el destino. Este proceso es crucial para garantizar la compatibilidad entre diferentes tipos de redes y sus respectivas limitaciones de tamaño de paquete.

El IP es un protocolo sin conexión, lo que significa que no garantiza la entrega confiable de los paquetes, ni asegura que los paquetes lleguen al destino en el orden correcto. Estas funciones son realizadas por protocolos de capas superiores, como el TCP (Transmission Control Protocol). Sin embargo, el IP garantiza que los paquetes sean encaminados correctamente entre las redes, utilizando routers que analizan la dirección IP de destino y determinan la mejor ruta para el paquete.

Además, el IP desempeña un papel fundamental en el control del tráfico de red, utilizando el campo TTL para limitar el número de saltos que los paquetes pueden realizar. Esto evita bucles de enrutamiento que pueden causar congestión en la red. En versiones más recientes, como IPv6, el protocolo también ofrece funcionalidades nativas de seguridad, como la implementación de IPsec, que garantiza la integridad y la confidencialidad de los datos.

ICMP (Internet Control Message Protocol)

El ICMP (Internet Control Message Protocol) es un protocolo de soporte crucial en la capa de red (capa 3) que ayuda en la comunicación y en el diagnóstico de problemas en redes IP.

El ICMP fue diseñado para ser un mecanismo de notificación de errores y diagnóstico dentro de redes IP. Permite que dispositivos de red, como routers y hosts, se comuniquen acerca de problemas de entrega de paquetes, congestión o fallas de ruta. Cuando ocurre un problema durante el enrutamiento de paquetes, el ICMP se utiliza para enviar mensajes al remitente original, notificándole la naturaleza del error o condición.

RIP (Routing Information Protocol)

El RIP (Routing Information Protocol) es uno de los protocolos de enrutamiento más antiguos y simples utilizados en redes IP para determinar el mejor camino para el envío de paquetes de datos entre diferentes redes. Pertenece a la categoría de protocolos de enrutamiento por vector de distancia y se utiliza en la capa de red del modelo OSI. El RIP fue desarrollado inicialmente para redes pequeñas, debido a su simplicidad y facilidad de implementación, pero a medida que las redes crecieron en complejidad y escala, el protocolo se volvió menos eficiente para entornos mayores.

El RIP determina la mejor ruta con base en el número de saltos (hops) entre el router de origen y el destino. Un salto se define como el paso de un paquete por un router. El RIP asigna un “costo” de 1 a cada salto, y la ruta con el menor número de saltos se considera la mejor. Tiene un límite máximo de 15 saltos para determinar la distancia, lo que significa que cualquier destino a más de 15 saltos se considera inalcanzable. Esta limitación hace que el RIP sea inadecuado para redes grandes, ya que puede causar problemas de escalabilidad y eficiencia.

El RIP es un protocolo de enrutamiento dinámico, lo que significa que los routers que lo utilizan intercambian información de enrutamiento periódicamente (cada 30 segundos) para garantizar que sus tablas de enrutamiento estén siempre actualizadas. Cada router mantiene una tabla de enrutamiento que lista las redes conocidas, el siguiente salto necesario para alcanzarlas y el número de saltos hasta el destino.

OSPF (Open Shortest Path First)

El OSPF (Open Shortest Path First) es un protocolo de enrutamiento dinámico utilizado en redes IP para determinar la mejor ruta entre dispositivos en una red. Pertenece a la categoría de protocolos de enrutamiento por estado de enlace y se utiliza ampliamente en redes corporativas y en redes de proveedores de servicios, debido a su escalabilidad, eficiencia y rápida convergencia. El OSPF está definido por el estándar de la IETF (Internet Engineering Task Force) y es considerado uno de los protocolos de enrutamiento interno (IGP – Interior Gateway Protocol) más robustos y utilizados en grandes redes.

A diferencia de otros protocolos de enrutamiento, como el RIP (Routing Information Protocol), que utiliza el conteo de saltos para determinar la mejor ruta, el OSPF utiliza el concepto de costo, que puede basarse en factores como el ancho de banda y otras métricas. El objetivo del OSPF es encontrar la ruta de menor costo para cada destino en la red, lo que se realiza por medio del algoritmo de Dijkstra, también conocido como el algoritmo del “camino más corto”.

El OSPF divide la red en áreas, lo que facilita la administración y la escalabilidad en redes muy grandes. El área principal, llamada área backbone (área 0), conecta todas las demás áreas. Los dispositivos dentro de una misma área intercambian información de estado de enlace (link-state) para construir una visión completa de la topología de la red, mientras que el tráfico entre áreas se enruta a través del área backbone.

BGP (Border Gateway Protocol)

El BGP (Border Gateway Protocol) es el protocolo de enrutamiento utilizado para interconectar diferentes sistemas autónomos (AS – Autonomous Systems) en Internet. Es un protocolo de enrutamiento externo (EGP – Exterior Gateway Protocol), lo que significa que su función principal es intercambiar información de enrutamiento entre redes distintas, llamadas sistemas autónomos, a diferencia de protocolos internos como OSPF o RIP, que operan dentro de un único sistema autónomo. El BGP es fundamental para el funcionamiento de Internet, siendo responsable de determinar las rutas más eficientes para el tráfico entre diferentes proveedores de servicio y grandes redes corporativas.

A diferencia de los protocolos de enrutamiento internos que determinan el mejor camino con base en métricas simples, como el conteo de saltos, el BGP utiliza un enfoque basado en políticas. Permite que los administradores de red configuren reglas específicas que determinan cómo deben enrutar los paquetes, con base en una serie de atributos de enrutamiento. Esto hace que el BGP sea altamente flexible e ideal para el entorno interconectado y complejo de Internet.

El BGP utiliza un sistema de peering para establecer conexiones entre routers de diferentes sistemas autónomos. Dos routers BGP que establecen una conexión se llaman peers. Estos peers intercambian información de enrutamiento entre sí, lo que incluye las rutas conocidas y sus atributos. Esta información se utiliza para construir tablas de enrutamiento que se emplean para encaminar el tráfico de datos entre las diferentes redes.

Capa de Transporte

La capa de transporte actúa directamente encima de la capa de red, manejando la comunicación de extremo a extremo entre los hosts y estableciendo y manteniendo la conexión entre ellos, independientemente de la infraestructura de red subyacente. Su principal objetivo es asegurar que los datos se transmitan de manera íntegra, incluso en redes de diferentes tecnologías o distancias.

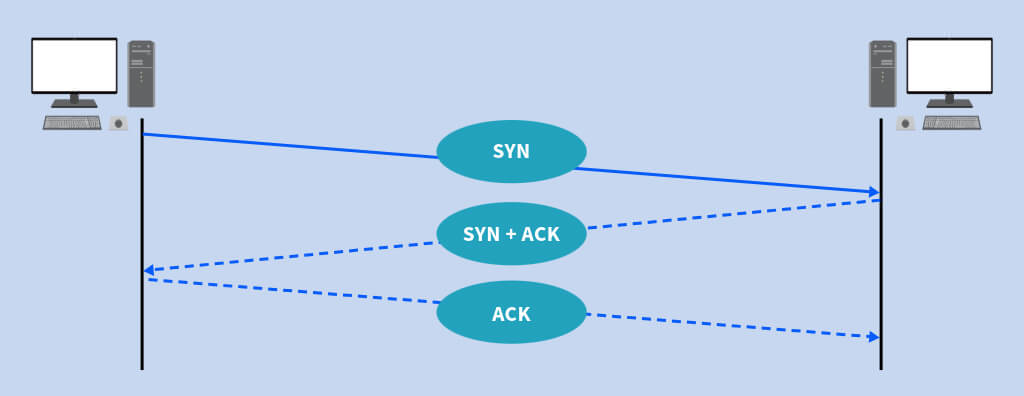

TCP (Transmission Control Protocol)

El TCP (Transmission Control Protocol) es uno de los protocolos más importantes y ampliamente utilizados en la capa de transporte. Su principal función es garantizar una comunicación confiable y orientada a conexión entre dos dispositivos en una red, proporcionando la entrega correcta de los datos y la integridad de la información transmitida. A diferencia de otros protocolos que no garantizan la entrega de los datos, el TCP ofrece mecanismos que aseguran que los paquetes lleguen al destino en orden y sin errores, lo que lo hace esencial para la mayoría de las aplicaciones de Internet, como la navegación web, el envío de correos electrónicos y la transferencia de archivos.

UDP (User Datagram Protocol)

El UDP (User Datagram Protocol) es un protocolo de la capa de transporte, diseñado para ofrecer un servicio de transmisión de datos simple y no confiable. A diferencia del TCP, el UDP es un protocolo no orientado a conexión, lo que significa que no realiza el establecimiento previo de una conexión antes de enviar datos entre dos dispositivos. El UDP simplemente envía los paquetes de datos, llamados datagramas, sin preocuparse por garantizar que lleguen al destino o que sean entregados en el orden correcto.

El UDP es mucho más ligero en términos de procesamiento y overhead en comparación con el TCP, lo que lo hace ideal para aplicaciones donde la velocidad es más importante que la confiabilidad. No implementa mecanismos de control de flujo, control de congestión ni recuperación de paquetes perdidos. Así, las aplicaciones que utilizan UDP deben tratar directamente esos aspectos, cuando sea necesario, o simplemente aceptar la pérdida de paquetes como parte del proceso.

Al no tener mecanismos de corrección de errores ni control de transmisión, el UDP envía los datagramas directamente a la red y no espera ningún tipo de reconocimiento o respuesta del destinatario. Esto puede resultar en pérdida de paquetes, duplicación o llegada fuera de orden, pero esa simplicidad también permite que el UDP sea extremadamente rápido y eficiente en términos de tiempo de respuesta.

El UDP se utiliza con frecuencia en aplicaciones donde la baja latencia y la velocidad de transmisión son más importantes que la entrega confiable de cada paquete. Ejemplos típicos incluyen streaming de video, transmisiones en tiempo real, VoIP (Voice over IP) y juegos online, donde pequeños retrasos o pérdidas de paquetes son aceptables y pueden pasar desapercibidos para los usuarios, pero la rapidez en la transmisión es esencial para la experiencia.

Capa de Aplicación

La capa de aplicación es la última capa en la arquitectura de redes, tanto en el modelo OSI como en el modelo TCP/IP, y es la interfaz directa entre las aplicaciones de los usuarios y la red subyacente. Su función es permitir que software y servicios puedan comunicarse y utilizar los recursos de la red para transmitir datos entre dispositivos. La capa de aplicación es responsable de proporcionar una variedad de servicios de red, permitiendo el intercambio de información, el acceso remoto, la navegación web, la transferencia de archivos, entre otras funcionalidades.

A diferencia de las capas inferiores, que lidian con la entrega de paquetes de datos, el enrutamiento y la corrección de errores, la capa de aplicación está enfocada en proporcionar servicios directamente a las aplicaciones. Define cómo los datos son interpretados y utilizados por las aplicaciones, además de ofrecer una interfaz para que los usuarios interactúen con los servicios de red de manera transparente. Así, es en esta capa donde ocurren las interacciones que más interesan a los usuarios, como la navegación en sitios web, el envío de correos electrónicos o el uso de programas de mensajería instantánea.

La función principal de la capa de aplicación es proporcionar los protocolos y servicios necesarios para que las aplicaciones puedan acceder y utilizar la red de manera eficaz. Esto incluye desde el formateo y la presentación de los datos hasta la autenticación y el control de acceso. La capa de aplicación también gestiona la codificación y decodificación de datos, asegurando que la información sea interpretada correctamente por los sistemas involucrados en la comunicación. Además, puede implementar mecanismos de seguridad para garantizar la protección de los datos durante la comunicación.

Otra función importante de la capa de aplicación es la sincronización y control de sesión. La capa garantiza que la comunicación entre dos partes ocurra de manera organizada, permitiendo que la información se intercambie de forma controlada y estructurada. Esto incluye la capacidad de iniciar, gestionar y finalizar sesiones de comunicación entre dispositivos, ya sea durante una transferencia de archivos, una llamada de voz o la interacción con un servidor de base de datos.

La capa de aplicación también desempeña un papel fundamental en la interfaz entre usuario y red, ofreciendo las herramientas necesarias para que las personas puedan interactuar con las funcionalidades de la red sin preocuparse por la complejidad técnica de las capas inferiores. Esta capa abstrae las complejidades de la comunicación de red, haciéndola accesible y fácil de usar para el usuario final. Funciones como la navegación en una página web o el envío de un correo electrónico son facilitadas por protocolos y servicios definidos en la capa de aplicación.

HTTP (HyperText Transfer Protocol)

El HTTP (Hypertext Transfer Protocol) es uno de los protocolos más ampliamente utilizados en la capa de aplicación, siendo fundamental para el intercambio de información en la Web. Define cómo los datos son solicitados y transmitidos entre navegadores (clientes) y servidores web, permitiendo la navegación en Internet tal como la conocemos hoy. El HTTP es el protocolo base para la transferencia de páginas web, y su simplicidad y eficacia lo convirtieron en el estándar de comunicación entre servidores y clientes en redes IP.

El HTTP sigue un modelo de solicitud-respuesta, donde un cliente (generalmente un navegador) realiza una solicitud a un servidor, y el servidor responde con los datos solicitados, como una página HTML, una imagen u otro recurso. La comunicación HTTP es stateless, es decir, cada solicitud es independiente y no guarda memoria de solicitudes anteriores. Esto significa que el servidor no mantiene el estado de la conexión entre diferentes solicitudes, lo que simplifica el protocolo, pero exige técnicas adicionales, como cookies, en casos donde la continuidad es necesaria, como en sesiones de inicio de sesión.

Cuando un usuario accede a un sitio escribiendo una dirección en el navegador, el navegador realiza una solicitud HTTP al servidor que aloja ese sitio. El servidor entonces procesa la solicitud y envía de vuelta la respuesta, que puede incluir el código HTML de la página, imágenes, hojas de estilo CSS, scripts JavaScript y otros recursos que componen la página web.

Originalmente, HTTP no incluía mecanismos de seguridad, lo que significaba que los datos circulaban por la red sin cifrado y podían ser interceptados y leídos por terceros. Para resolver esta cuestión, se introdujo HTTPS (HTTP Secure), que utiliza el protocolo SSL/TLS para cifrar la comunicación entre el cliente y el servidor. El HTTPS garantiza que los datos transmitidos sean confidenciales y estén protegidos contra ataques de interceptación y manipulación.

FTP (File Transfer Protocol)

El FTP (File Transfer Protocol) es un protocolo de la capa de aplicación diseñado específicamente para la transferencia de archivos entre dispositivos en una red. El FTP es uno de los protocolos más antiguos de Internet y se utiliza ampliamente para mover grandes volúmenes de datos entre un cliente y un servidor, permitiendo tanto el envío como la descarga de archivos.

El FTP es una solución simple y eficaz para la gestión de archivos en servidores remotos, siendo muy utilizado por desarrolladores y administradores de sistemas para alojar y gestionar sitios web, realizar copias de seguridad o transferir grandes conjuntos de datos.

SMTP (Simple Mail Transfer Protocol)

El SMTP (Simple Mail Transfer Protocol) es el protocolo estándar utilizado para el envío de correos electrónicos a través de Internet. Forma parte de la capa de aplicación y es responsable de transferir mensajes de correo electrónico desde un servidor de envío a otro servidor de correo, hasta que el mensaje alcanza su destino.

El SMTP fue diseñado para manejar exclusivamente el envío de mensajes, mientras que la recepción y lectura de los correos se realizan mediante otros protocolos, como IMAP (Internet Message Access Protocol) o POP3 (Post Office Protocol).

DNS (Domain Name System)

El DNS (Domain Name System) es uno de los protocolos más fundamentales de la capa de aplicación, responsable de traducir nombres de dominio legibles por humanos en direcciones IP que pueden ser utilizadas por computadoras y dispositivos de red para localizar y comunicarse con otros dispositivos en Internet. El DNS actúa como una especie de “guía telefónica” de Internet, permitiendo que los usuarios accedan a sitios y servicios escribiendo nombres amigables, en lugar de memorizar secuencias numéricas complejas.

La Importancia de los Protocolos de Red

Los protocolos de red son fundamentales para el funcionamiento de cualquier sistema de comunicación, tanto en redes locales como en la Internet global. Son responsables de establecer las reglas y los procedimientos que gobiernan el intercambio de datos entre dispositivos, desde computadoras personales y smartphones hasta servidores de grandes corporaciones. Sin protocolos de red, la comunicación entre diferentes dispositivos y sistemas, que muchas veces utilizan tecnologías y arquitecturas distintas, sería imposible.

Interoperabilidad

Una de las principales funciones de los protocolos de red es garantizar la interoperabilidad entre dispositivos de diferentes fabricantes y tecnologías. Cada dispositivo puede tener su propio hardware y software, pero, al seguir un conjunto estandarizado de protocolos, logran comunicarse de manera eficaz. Protocolos como TCP/IP, por ejemplo, permiten que redes complejas y heterogéneas funcionen de manera integrada, desde pequeños dispositivos domésticos hasta los grandes servidores que sostienen Internet.

La estandarización proporcionada por los protocolos garantiza que dispositivos conectados en redes de área local (LAN) o redes de larga distancia (WAN) puedan intercambiar información de forma segura y eficiente. Esto es especialmente importante en un escenario donde el Internet de las Cosas (IoT) y la conectividad global se están expandiendo rápidamente, con miles de millones de dispositivos que necesitan compartir información.

Confiabilidad de la Comunicación

Otro papel crucial de los protocolos de red es asegurar la confiabilidad de la comunicación. Protocolos como TCP (Transmission Control Protocol) ofrecen mecanismos que garantizan que los datos se entreguen de manera íntegra y en el orden correcto. Manejan problemas como la pérdida de paquetes, los errores de transmisión y la congestión de red, implementando técnicas de corrección de errores y retransmisión de paquetes. Sin estos mecanismos, sería común que información importante se corrompiera o se perdiera durante la transmisión, comprometiendo la integridad de los datos y la confiabilidad de las redes.

Incluso protocolos más simples, como el UDP (User Datagram Protocol), que priorizan la velocidad en detrimento de la confiabilidad, tienen su papel en aplicaciones que exigen baja latencia y alto rendimiento, como el streaming de video o los juegos online. Esto muestra cómo los protocolos se adaptan a diferentes necesidades y aplicaciones, garantizando que cada tipo de comunicación sea tratado de forma apropiada.

Eficiencia y Organización de la Comunicación

Los protocolos de red organizan la comunicación de manera que los datos sean enviados y recibidos de forma eficiente. Determinan cómo los datos deben ser fragmentados en paquetes, direccionados, enrutados a través de la red y recompuestos en el destino. Protocolos como IP (Internet Protocol) gestionan el enrutamiento de paquetes de datos a través de varias redes, garantizando que los datos sigan el camino más eficiente hasta su destino, incluso cuando hay múltiples saltos y redes intermedias involucradas.

Además, los protocolos ayudan a gestionar el control de flujo y el control de congestión, evitando que las redes se sobrecarguen y garantizando que los dispositivos no sean inundados con más datos de los que pueden procesar. Esto asegura que la red mantenga un rendimiento optimizado, incluso en condiciones de tráfico intenso.

Seguridad

Otro aspecto vital de los protocolos de red es la seguridad. Protocolos como HTTPS (Hypertext Transfer Protocol Secure), SSL/TLS (Secure Sockets Layer/Transport Layer Security) e IPsec desempeñan papeles críticos en la protección de la información que circula por la red, garantizando que los datos estén cifrados y que la comunicación sea autenticada. Sin estos protocolos, las comunicaciones por Internet serían altamente vulnerables a ataques de interceptación y manipulación.

Además, protocolos como DNSSEC (Domain Name System Security Extensions) ayudan a proteger la integridad del sistema DNS, impidiendo ataques que podrían redirigir a los usuarios a sitios maliciosos.

Escalabilidad

A medida que Internet y las redes corporativas continúan creciendo, la escalabilidad proporcionada por los protocolos de red es esencial. Protocolos como BGP (Border Gateway Protocol), que gestiona el enrutamiento entre diferentes sistemas autónomos en Internet, garantizan que grandes redes puedan interconectarse de manera eficiente y que el tráfico de datos fluya entre diferentes regiones del mundo.

Con la aparición de nuevas tecnologías, como IPv6, los protocolos también se están adaptando para soportar un número creciente de dispositivos conectados. El IPv6, por ejemplo, fue diseñado para lidiar con la limitación de direcciones IP del IPv4, proporcionando un espacio de direccionamiento mucho mayor, esencial para el futuro de la conectividad global.

Consideraciones Finales

Los protocolos de red desempeñan un papel fundamental en la organización, la seguridad y la confiabilidad de la comunicación entre dispositivos conectados. Sin estos protocolos, Internet y otras redes de comunicación simplemente no podrían funcionar como lo hacen hoy. Garantizan que los datos puedan transmitirse de manera eficiente, segura y escalable, permitiendo que redes heterogéneas y dispositivos diversos colaboren e intercambien información a escala global. En un mundo cada vez más conectado, la importancia de los protocolos de red no puede subestimarse, ya que constituyen la base de la comunicación digital moderna.

Conclusión

En resumen, exploramos una visión general de los principales protocolos de red, fundamentales para la comunicación digital eficiente y segura.

Existen innumerables protocolos de red, cada uno diseñado para atender necesidades y funciones específicas, desde el envío de correos electrónicos y la navegación web hasta la transmisión de datos en tiempo real y el enrutamiento de paquetes en redes complejas.

Aunque hemos ofrecido una visión general de los más importantes, el universo de los protocolos de red es vasto y está en constante evolución, acompañando el crecimiento de las tecnologías y la demanda por redes más rápidas, seguras y eficientes.

Comprender cómo operan estos protocolos es fundamental para cualquier profesional de TI, ingeniero de redes o desarrollador, porque garantizan que la comunicación entre diferentes sistemas y dispositivos ocurra de manera confiable e interoperable.

Esperamos que esta introducción haya sido útil para ampliar su comprensión sobre el papel esencial de los protocolos en la infraestructura de redes.