Comprenda cómo la latencia, el jitter y la pérdida de paquetes afectan la calidad de la transmisión de video y qué estrategias de mitigación son más eficaces en redes críticas.

¡Descúbrelo!

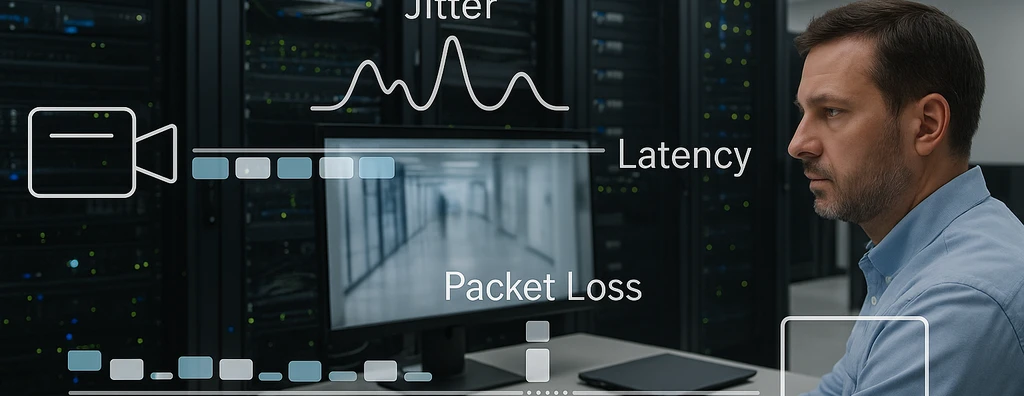

La transmisión de video sobre redes de datos se ha convertido en un elemento estratégico en entornos corporativos, aplicaciones residenciales y especialmente en sistemas críticos de seguridad electrónica, donde la integridad y el tiempo de entrega de las imágenes son factores determinantes para la eficiencia del monitoreo y de las respuestas operativas. Sin embargo, los desafíos relacionados con la latencia, la variabilidad del retardo, o jitter, y la pérdida de paquetes afectan directamente la experiencia final y pueden comprometer desde la visibilidad en tiempo real hasta la grabación fiel de los eventos. La comprensión técnica de estos parámetros es fundamental para la ingeniería de redes orientada a alto rendimiento, disponibilidad y calidad de servicio.

En este artículo se examinan los conceptos de latencia, jitter y pérdida de paquetes, sus relaciones de causa y efecto en la transmisión de video, los mecanismos para mitigar sus impactos y sus implicaciones prácticas en proyectos, operación y dimensionamiento de redes destinadas al tráfico de video. El objetivo es proporcionar fundamentos técnicos para decisiones críticas en ingeniería, arquitectura y operación de sistemas de transmisión audiovisual.

Siga leyendo.

[elementor-template id=”24446″]

Latencia: Concepto, Orígenes y Efectos en la Transmisión de Video

La latencia se define como el tiempo total transcurrido entre el envío de un paquete de datos por la fuente y su recepción en el destino. Este parámetro abarca varios componentes, incluidos el procesamiento en los equipos de red, el tiempo de propagación física de la señal, el encolamiento en buffers y el tratamiento de protocolos en cada nodo intermedio.

En la transmisión de video, latencias elevadas pueden generar un retraso perceptible excesivo entre el evento monitoreado y su presentación al usuario, dificultando la interacción en aplicaciones sensibles al tiempo, como videoconferencia y videomonitorización en vivo. Es importante distinguir:

- Latencia de propagación: Tiempo físico requerido para que la señal recorra el medio de transmisión;

- Latencia de procesamiento: Tiempo consumido en nodos de enrutamiento o switching debido al tratamiento de paquetes;

- Latencia de encolamiento: Retardo causado por congestión en los buffers de switches y routers;

- Latencia de aplicación: Tiempo de procesamiento y buffering en los dispositivos finales, incluida la compresión y descompresión de video.

Valores elevados, incluso cuando son constantes, limitan la agilidad y la viabilidad de determinados servicios de video.

Jitter: Variación del Retardo y Sus Consecuencias

Jitter es la expresión técnica para la variación del tiempo de llegada de los paquetes al destino con respecto al intervalo temporal originalmente previsto. En las redes de datos, especialmente las basadas en paquetes IP, el jitter surge de condiciones dinámicas de enrutamiento, congestión momentánea, balanceo de rutas y priorización diferenciada de flujos.

Los impactos del jitter en la transmisión de video incluyen:

- Ruptura de la continuidad en la presentación de cuadros, o frames;

- Pausas perceptibles o saltos en la reproducción de las imágenes;

- Desincronización entre audio y video en transmisiones multimedia sincronizadas;

- Necesidad de implementar buffers de compensación mayores, aumentando la latencia total del sistema.

Las aplicaciones interactivas y de monitoreo en tiempo real requieren valores minimizados de jitter, ya que grandes oscilaciones hacen inviable el uso eficaz de los sistemas, generando experiencias degradadas y riesgos operativos.

Pérdida de Paquetes: Efectos Directos en la Calidad Visual y la Confiabilidad

La pérdida de paquetes se refiere a la falta de entrega de determinados paquetes enviados entre origen y destino, debido a descartes en nodos congestionados, errores de transmisión o fallos en el procesamiento de los equipos intermedios.

En el contexto de la transmisión de video, la pérdida puede provocar:

- Cuadros, o frames, parcial o totalmente ausentes en la secuencia reproducida;

- Fragmentación o distorsión visual, perceptible en eventos de mayor duración o frecuencia;

- Saltos repentinos de escena que comprometen el análisis forense y el seguimiento en tiempo real;

- En protocolos que evitan la retransmisión para favorecer menor latencia, la ausencia de paquetes tiende a ser enmascarada mediante técnicas como repetición de cuadros anteriores, inserción de cuadros en blanco o ambiente sonoro de relleno.

Los sistemas críticos y las aplicaciones altamente sensibles, como la seguridad perimetral y la videomonitorización de entornos estratégicos, deben prever tasas máximas de pérdida tolerable, dimensionando adecuadamente la arquitectura y los mecanismos de calidad de servicio.

Relaciones entre Latencia, Jitter y Pérdida de Paquetes

Los tres parámetros están interconectados por su dependencia de factores como la tasa de ocupación de ancho de banda, el diseño de enrutamiento, la sobrecarga de buffers y la eficiencia de los algoritmos de priorización, o QoS. La mitigación del jitter exige aumentar el tamaño de los buffers, lo que a veces contribuye al crecimiento de la latencia total. Por otro lado, buffers demasiado pequeños pueden causar descarte de paquetes bajo congestión, elevando la tasa de pérdida.

El dimensionamiento del punto de reproducción en el cliente depende del equilibrio entre:

- Latencia aceptable: definida por el máximo retardo tolerable sin comprometer la utilidad del video en tiempo real;

- Acomodación del jitter: mediante buffers suficientemente grandes para absorber variaciones sin interrupciones perceptibles;

- Riesgo de pérdida: calculado a partir de la capacidad de la red para entregar paquetes a tiempo antes de su descarte o sustitución.

Esta interdependencia requiere cálculos cuidadosos y monitoreo continuo, sobre todo en topologías críticas.

Mecanismos y Estrategias de Mitigación

El mantenimiento de la calidad de transmisión de video exige la implementación de técnicas específicas a lo largo de la infraestructura de red y en los endpoints:

- Buffers de jitter: Implementación de áreas temporales en los terminales receptores para acomodar la llegada irregular de paquetes y liberarlos para procesamiento en flujos continuos. El dimensionamiento del buffer es directamente proporcional a la variación esperada del retardo, haciéndose mayor conforme aumenta el jitter tolerable.

- Mecanismos de Calidad de Servicio, o QoS: Clasificación, priorización y reserva de ancho de banda para flujos de video sensibles, reduciendo riesgos de congestión y pérdida de paquetes. Tecnologías como colas con prioridad y marcado de paquetes son fundamentales.

- Monitoreo y ajuste dinámico: Análisis constante de los parámetros operativos de la red, lógica adaptativa para ajustar el playback point, selección inteligente de rutas y algoritmos de compresión adecuados a la variabilidad de los indicadores medidos.

Cabe señalar que cuanto menores son la latencia y el jitter, más estrecha se vuelve la ventana para recuperación de fallos y reposición de paquetes, lo que exige soluciones preventivas y niveles de tolerancia bien definidos.

Implicaciones Prácticas en Proyectos y Operación de Redes de Video

Los proyectos que involucran transmisión de video en tiempo real, como videomonitorización, telemedicina y broadcast corporativo, imponen exigencias estrictas sobre latencia, jitter y pérdida de paquetes. Para aplicaciones sensibles, se recomienda una definición clara de los parámetros del SLA, o Service Level Agreements, considerando:

- Parámetros máximos de latencia extremo a extremo, respetando la finalidad del sistema;

- Índices de jitter compatibles con la tolerancia de la aplicación embarcada y la expectativa del usuario final;

- Tasas máximas de pérdida por flujo, previendo redundancia y compensación cuando sea necesario;

- Capacidad de monitoreo, diagnóstico y respuesta automática ante degradaciones del servicio, con alertas y registros detallados para análisis forense.

La ingeniería de redes debe prever arquitecturas flexibles y resilientes, capaces de admitir picos de uso, variaciones ambientales y crecimiento de la demanda. Las pruebas de estrés, simulaciones y mediciones periódicas forman parte del ciclo continuo de mejora y aseguramiento de la calidad de estas infraestructuras.

La latencia, el jitter y la pérdida de paquetes son determinantes centrales para la calidad de la transmisión de video en redes de datos, exigiendo un enfoque sistémico en proyectos, operación y mantenimiento. Las definiciones precisas de parámetros y la planificación enfocada en tolerancia y mitigación contribuyen a reducir riesgos operativos y elevar el rendimiento en las aplicaciones más exigentes. El éxito de las soluciones de video reside en políticas de calidad de servicio, dimensionamiento de buffers, elección cuidadosa de la topología y monitoreo continuo. En entornos críticos y sensibles, se recomienda la adopción de prácticas proactivas, la integración de recursos de diagnóstico y el alineamiento constante de los indicadores operativos con la expectativa de calidad del negocio y del usuario final.