Las cuestiones de rendimiento son críticas en las redes de computadoras, especialmente en entornos con muchos dispositivos interconectados.

¡Descúbrelo!

Las cuestiones de rendimiento son críticas en las redes de computadoras. En entornos con cientos o miles de dispositivos interconectados, surgen interacciones complejas, a menudo con consecuencias imprevisibles.

Esta complejidad puede provocar degradación del rendimiento, muchas veces sin una causa inmediatamente identificable.

En este artículo abordaremos algunos aspectos esenciales del rendimiento de red.

Veámoslo.

[elementor-template id=”24446″]

¿Qué define el rendimiento de una red?

Comprender el comportamiento de una red bajo carga es, por desgracia, más cercano a un arte que a una ciencia exacta. Existe escasez de modelos teóricos que puedan aplicarse de forma práctica en entornos reales. Lo más útil disponible son directrices basadas en experiencias reales de operación en campo.

El rendimiento efectivo percibido por las aplicaciones depende de la interacción entre las capas de enlace, red y transporte.

Las redes mal dimensionadas, con topologías desequilibradas, equipos activos subdimensionados o ausencia de mecanismos de control degradan la experiencia del usuario, comprometen aplicaciones críticas y generan cuellos de botella difíciles de diagnosticar sin una metodología adecuada.

Medición del rendimiento y troubleshooting

Cuando una red presenta lentitud, inestabilidad o pérdida de conectividad, es común que los usuarios recurran al equipo técnico para informar el problema y exigir soluciones inmediatas. Sin embargo, cualquier intervención eficaz depende, antes que nada, de un análisis fundamentado en datos concretos.

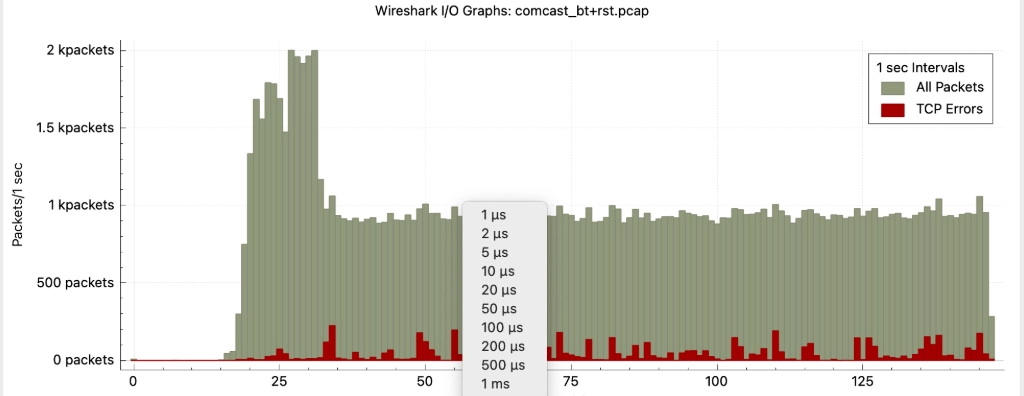

Los diagnósticos precisos exigen mediciones sistemáticas, realizadas en diferentes capas de la pila de protocolos y en múltiples puntos de la infraestructura. Las métricas relevantes incluyen, por ejemplo, el tiempo de respuesta entre el envío y el reconocimiento de un segmento, la tasa efectiva de transferencia (throughput), la pérdida de paquetes por intervalo de tiempo, el jitter y el volumen total de datos procesados en un período determinado.

El troubleshooting de red es el proceso de diagnóstico y resolución de problemas que afectan la conectividad, el rendimiento y la operación de la infraestructura de red. Este proceso implica identificar el origen de los problemas de red, que pueden estar tanto en la capa física (como cableado y equipos) como en la capa lógica (configuraciones y protocolos).

Principales problemas de rendimiento

Identificar y comprender los principales puntos de degradación es esencial para construir entornos resilientes, escalables y preparados para mantener el rendimiento bajo diferentes escenarios de carga.

A continuación, se abordan los problemas más recurrentes y los efectos asociados a cada uno.

Congestión

La congestión ocurre cuando el volumen de tráfico en un punto de la red supera la capacidad de encaminamiento o conmutación del equipo responsable, como routers, switches o firewalls. Esta condición lleva a la acumulación de paquetes en cola, a la saturación de buffers y, eventualmente, a la pérdida de paquetes.

La congestión puede ser transitoria, causada por picos de utilización, o recurrente, cuando existen fallas de dimensionamiento o ausencia de mecanismos de control de tráfico. Los entornos sin una priorización adecuada, como QoS, tienden a amplificar el impacto, afectando incluso a aplicaciones sensibles al tiempo, como voz, video y acceso remoto.

Desequilibrios entre interfaces

Los desequilibrios entre interfaces ocurren cuando los dispositivos interconectados operan con capacidades de enlace distintas, como en conexiones entre puertos gigabit y puertos Fast Ethernet. Este tipo de asimetría introduce cuellos de botella previsibles y limita el rendimiento global de la red.

Cuando una interfaz de mayor velocidad transmite datos a otra de menor capacidad, existe riesgo de saturación del puerto receptor, formación de colas y descarte de paquetes. Este comportamiento afecta no solo al tráfico directo, sino también a otros flujos que comparten el mismo camino o dispositivo de conmutación.

Jitter

La variación de latencia, conocida como jitter, representa un desafío crítico para aplicaciones sensibles al tiempo, como voz sobre IP (VoIP), videoconferencia, videovigilancia y streaming en tiempo real. Incluso con ancho de banda suficiente, la falta de regularidad en la entrega de los paquetes puede comprometer significativamente la calidad de la experiencia.

Las redes sujetas a jitter presentan un comportamiento imprevisible, con oscilaciones en el tiempo de entrega causadas por congestiones intermitentes, falta de priorización del tráfico o compartición no controlada de enlaces.

Sobrecarga síncrona

También existen situaciones de sobrecarga síncrona, desencadenadas por eventos específicos. Un caso clásico ocurre cuando se transmite un segmento malformado, por ejemplo, con un número de puerto no válido. Si ese segmento se envía a una dirección de broadcast, cada uno de los dispositivos receptores puede generar una respuesta de error, provocando una tormenta de respuestas ICMP.

Este tipo de broadcast storm puede colapsar la red. Este comportamiento fue especialmente problemático en redes UDP hasta que el protocolo ICMP fue ajustado para suprimir respuestas a errores de broadcast en segmentos UDP. En redes inalámbricas, el riesgo es aún mayor, dado el uso natural de broadcast y la limitación de ancho de banda en estos medios.

Otro ejemplo común de sobrecarga síncrona ocurre después de un corte de energía. Cuando se restablece la alimentación, múltiples dispositivos se reinician simultáneamente. Durante el proceso de arranque, es habitual que los hosts soliciten direccionamiento vía DHCP e inicien la carga de sistemas operativos por la red. En centros de datos, este comportamiento simultáneo puede saturar fácilmente los servidores y colapsar el servicio de arranque remoto.

Arquitectura de redes de alto rendimiento

Los ajustes, las mediciones y un buen troubleshooting pueden mejorar el rendimiento de la red de forma significativa, pero no sustituyen un buen proyecto desde el inicio. En una arquitectura mal concebida, el margen de optimización es limitado. En esas situaciones, la readecuación de la red es inevitable para alcanzar niveles adecuados de eficiencia.

Red física

Una arquitectura de red de alto rendimiento comienza con una base física sólida.

El rendimiento lógico solo será consistente si los elementos de la infraestructura física están correctamente especificados, instalados y validados.

Esto incluye desde el cableado estructurado hasta la selección de equipos activos, pasando por aspectos frecuentemente descuidados como la distribución eléctrica y la protección contra sobretensiones. A continuación, se presentan los principales componentes de esta capa.

Infraestructura de cableado

La estabilidad operativa de una red depende directamente de la calidad y conformidad de la infraestructura de cableado.

Los proyectos mal ejecutados introducen pérdida de señal, diafonía, variaciones de impedancia y degradación de la integridad de los paquetes, factores que afectan la comunicación incluso entre dispositivos de alta capacidad.

La adopción de normas como TIA/EIA-568, el uso de materiales certificados y la segregación física de enlaces por tipo de servicio (datos, voz, automatización) son prácticas fundamentales para garantizar un rendimiento sostenido.

Rutas técnicas bien planificadas, identificación estandarizada, respeto al radio de curvatura, control de interferencia electromagnética y validación con certificadores garantizan que la capa física no se convierta en un futuro punto de falla.

Cobertura de red Wi-Fi

El proyecto de cobertura Wi-Fi debe tratarse con el mismo rigor técnico aplicado al cableado. La distribución incorrecta de puntos de acceso, la superposición de canales o el desequilibrio de potencia entre celdas puede generar zonas de sombra, alta latencia y degradación del throughput.

Para entornos corporativos, es esencial realizar levantamientos de espectro, aplicar planificación de canales con base en el modelo de densidad de dispositivos y adoptar controladoras con gestión dinámica de RF. Además, debe considerarse la coexistencia de servicios críticos en el medio inalámbrico y la aplicación de políticas de QoS compatibles con tráfico sensible, como voz y video.

Equipos de red

La selección de los equipos de red debe basarse en criterios técnicos que van más allá de la velocidad nominal de las interfaces. Es necesario considerar la capacidad de conmutación, la tasa de reenvío por paquete, la disponibilidad de buffers, el tiempo de latencia interna, el soporte para protocolos actuales (802.1Q, 802.3ad, LACP, SNMP, QoS) y los recursos de gestión y seguridad.

El uso de equipos con tablas MAC limitadas, buffers insuficientes o sin soporte para VLANs puede comprometer seriamente el rendimiento de la red. Lo mismo ocurre con switches de acceso basados en Fast Ethernet que, aunque todavía son comunes en entornos legados, introducen cuellos de botella críticos en backbones gigabit o multigigabit.

Las redes proyectadas únicamente con base en la velocidad de acceso del usuario final tienden a fallar en escenarios con múltiples servicios concurrentes, como sistemas de videovigilancia, aplicaciones en la nube, telefonía IP e integraciones con dispositivos IoT.

Distribución eléctrica y protección

Aunque no forma parte directa del tráfico de red, la calidad del suministro eléctrico interfiere directamente en la estabilidad de los equipos activos. Caídas de tensión, variaciones de frecuencia, sobretensiones y ausencia de un sistema de puesta a tierra funcional adecuado son causas frecuentes de fallas intermitentes, reinicios inesperados de equipos y corrupción de datos en dispositivos sensibles.

La adopción de sistemas de alimentación redundante, el uso de UPS con autonomía compatible, la protección contra sobretensiones en cuadros de TI y la correcta implementación del sistema de puesta a tierra y equipotencialización son exigencias mínimas en entornos que requieren alta disponibilidad. La negligencia en este punto compromete toda la red, incluso cuando los demás elementos están correctamente especificados.

Red lógica

Una arquitectura lógica bien diseñada permite que la red se mantenga estable y previsible incluso bajo carga variable, múltiples servicios concurrentes o condiciones adversas.

Segmentación mediante VLANs

El uso de VLANs permite la separación lógica de dominios de broadcast dentro de una misma infraestructura física. Esta segmentación reduce el tráfico innecesario entre dispositivos, mejora la seguridad mediante aislamiento y facilita la gestión de grupos de equipos o servicios específicos (por ejemplo: usuarios, servidores, cámaras IP y sistemas de automatización).

Las VLANs correctamente planificadas evitan la propagación de paquetes no deseados y simplifican la aplicación de políticas de seguridad, ACLs, enrutamiento interno y QoS. También son fundamentales para garantizar la escalabilidad de la red en entornos con múltiples áreas funcionales o servicios convergentes.

QoS y priorización de tráfico

El tráfico de red no es homogéneo. Aplicaciones como VoIP, videoconferencia y sistemas de control requieren baja latencia, jitter mínimo y entrega continua. Servicios como backup, sincronización en la nube y navegación web son más tolerantes a las variaciones.

La implementación de políticas de QoS (Quality of Service) permite clasificar, marcar, encolar y tratar los paquetes según su criticidad. Esto garantiza que los flujos más sensibles se transmitan con prioridad, incluso en escenarios de alta utilización. Sin QoS, cualquier congestión temporal puede degradar servicios esenciales.

Enrutamiento y redundancia lógica

En redes con múltiples subredes y puntos de distribución, el enrutamiento adecuado es esencial para garantizar una comunicación eficiente y una selección resiliente de rutas. Protocolos dinámicos como OSPF, EIGRP o BGP permiten adaptación rápida ante fallas y balanceo de carga entre los caminos disponibles.

Además, la implementación de mecanismos como VRRP o HSRP garantiza redundancia de gateway y failover automático. Los proyectos que dependen únicamente de enrutamiento estático y no cuentan con contingencia lógica están sujetos a interrupciones totales ante fallas puntuales.

Control de broadcast y multicast

El tráfico broadcast y multicast, cuando no se controla, puede consumir recursos valiosos de la red y afectar negativamente el rendimiento general. El uso de VLANs junto con mecanismos como storm control, IGMP snooping y limitación de broadcast por puerto son medidas fundamentales para mantener la estabilidad en dominios extensos.

Los entornos con dispositivos IoT, descubrimiento vía broadcast o transmisión de video multicast deben equilibrarse cuidadosamente para evitar que el propio control del tráfico se convierta en un vector de saturación.

El papel del host en el rendimiento de la red

Aunque la infraestructura física y lógica sea responsable de sostener la mayor parte del rendimiento de una red, el comportamiento de los hosts también influye directamente en la eficiencia de la comunicación. En muchos casos, la limitación no está en el enlace ni en los equipos de red, sino en la forma en que el sistema operativo y la aplicación manipulan los datos.

A nivel del sistema operativo, factores como la gestión de buffers, el tratamiento de interrupciones, la planificación de procesos y las llamadas al sistema impactan el rendimiento de la pila de red. Los hosts que realizan múltiples copias internas de paquetes, operan con buffers subdimensionados o procesan bloques muy pequeños generan sobrecarga local y aumentan la latencia de forma perceptible, incluso en redes optimizadas.

En la capa de aplicación, la forma en que se manipulan los datos influye directamente en el rendimiento. Las aplicaciones que segmentan los datos de manera ineficiente, no mantienen persistencia de conexiones u operan con intervalos de envío inadecuados reducen el aprovechamiento de la ventana de transmisión y penalizan el throughput. Los servicios que utilizan polling excesivo, retransmisión redundante o que no son sensibles a la latencia terminan generando tráfico innecesario o poco optimizado.

La importancia de la documentación

La documentación técnica es una parte integrante y obligatoria de cualquier proyecto de red de alta disponibilidad. Su ausencia compromete la operación segura del entorno, eleva el tiempo de respuesta en situaciones de falla e impacta directamente el costo operativo de la empresa.

Los entornos corporativos están sujetos a interrupciones no planificadas (downtime) que, aunque sean breves, resultan en pérdida de productividad, interrupción de servicios esenciales, indisponibilidad de sistemas y, en muchos casos, perjuicio financiero. En redes críticas, cada minuto de indisponibilidad representa un costo real, ya sea en términos operativos, comerciales o reputacionales.

Una estructura de red sin documentación actualizada impone barreras para la identificación de fallas, dificulta los mantenimientos correctivos o preventivos y retrasa cualquier proceso de troubleshooting. Por otro lado, la existencia de documentación técnica completa reduce drásticamente el tiempo de diagnóstico y recuperación, viabiliza acciones rápidas y precisas, y brinda soporte a la continuidad operativa con mínima exposición a riesgos.

La documentación debe contemplar todos los elementos del proyecto, incluyendo:

- Plano de planta con rutas técnicas y puntos de red;

- Tablas de direccionamiento IP, VLANs y subredes;

- Diagrama lógico y físico de la topología;

- Registros de configuración de switches, routers, firewalls y controladoras;

- Políticas de QoS, enrutamiento y seguridad;

- Relación de interdependencia entre sistemas y servicios.

Por lo tanto, la elaboración, organización y entrega formal de la documentación técnica son condiciones indispensables para mantener el rendimiento y la confiabilidad de la red a lo largo del tiempo, incluso en procesos de expansión, soporte, auditoría o transferencia de responsabilidad técnica.

Consideraciones finales

El rendimiento en redes corporativas es el resultado directo de un conjunto de decisiones técnicas tomadas desde la fase de proyecto hasta la operación continua. Cableado estructurado de calidad, equipos correctamente dimensionados, arquitectura lógica coherente, control de tráfico y documentación completa forman los pilares de una red eficiente, escalable y resiliente.

Diagnosticar y resolver problemas exige método, datos confiables y conocimiento técnico, y no acciones reactivas basadas en prueba y error. Del mismo modo, las redes mal segmentadas, con ausencia de control de broadcast o sin priorización de tráfico crítico, tienden a presentar inestabilidad a medida que aumenta la demanda.

Conclusión

El rendimiento, la estabilidad y la escalabilidad en redes corporativas son resultados directos de un proyecto técnicamente fundamentado.

Las redes críticas exigen planificación, validación y documentación completa. Sin proyecto, no hay control. Y sin control, no hay rendimiento sostenible.

¿Necesita estructurar su red con base técnica y entregables formales?